AI 백엔드 실습을 통해 LLM API 연동, 데이터베이스 저장, 미니 RAG(Retrieval-Augmented Generation) 구축 방법을 2026년 최신 기준으로 상세히 안내합니다. 이 가이드에서는 macOS 환경에서 필요한 프로그램 설치부터 FastAPI, PostgreSQL 연동, Gemini API 키 발급까지 전 과정을 단계별로 설명하여 누구나 쉽게 따라 할 수 있도록 구성했습니다.

AI 백엔드 실습 환경 설정은 어떻게 하나요?

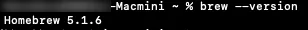

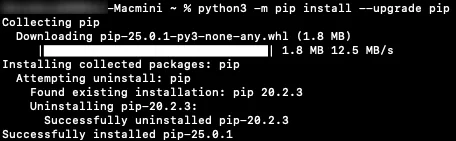

AI 백엔드 실습을 위한 개발 환경 설정은 몇 가지 필수 단계를 거쳐야 합니다. 먼저, macOS 운영체제와 Python 3.11 버전을 확인하는 것으로 시작합니다. 터미널에서 `python3 --version` 명령어로 버전을 확인할 수 있습니다. 이후, Homebrew를 설치하고 `brew --version`으로 정상 설치 여부를 확인합니다. Homebrew 설치 명령어는 `/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"`입니다. 다음으로, pip를 최신 버전으로 업그레이드하기 위해 `python3 -m pip install --upgrade pip` 명령어를 실행합니다. 이 과정은 이후 라이브러리 설치 시 발생할 수 있는 호환성 문제를 예방하는 데 중요합니다.

필수 라이브러리 설치 및 데이터베이스 연동 방법은 무엇인가요?

관련 글

프로젝트 폴더를 생성하고 가상 환경을 설정하는 것이 다음 단계입니다. `mkdir ai-backend-practice`로 폴더를 만들고 `cd ai-backend-practice`로 이동한 후, `python3 -m venv venv` 명령어로 가상 환경을 생성합니다. 가상 환경 활성화는 `source venv/bin/activate` 명령어로 이루어지며, 활성화되면 터미널 앞에 `(venv)` 표시가 나타납니다.

Gemini API 키 발급 및 연동 준비는 어떻게 하나요?

LLM API 연동을 위해 Gemini API 키를 준비해야 합니다. Google AI Studio에 접속하여 왼쪽 사이드바의 'Get API key' 메뉴를 클릭합니다. 여기서 'Create API key in a new project'를 선택하여 새로운 프로젝트를 생성하고 API 키 이름을 지정합니다. 예를 들어, 'test' 프로젝트를 생성하고 'TEST Gemini API Key'라는 이름을 부여할 수 있습니다. 키 생성이 완료되면 API 키 세부 정보 화면에서 복사 버튼을 눌러 발급받은 키를 안전하게 보관합니다. 이 API 키는 추후 LLM 모델을 호출할 때 인증 정보로 사용되므로, `.env` 파일과 같은 환경 변수 관리 도구를 사용하여 코드 외부에 저장하는 것이 보안상 권장됩니다. `python-dotenv` 라이브러리를 활용하면 이 환경 변수를 쉽게 불러올 수 있습니다.

미니 RAG 구축을 위한 핵심 구성 요소는 무엇인가요?

미니 RAG(Retrieval-Augmented Generation) 시스템은 LLM이 외부 데이터 소스에서 관련 정보를 검색하여 답변을 생성하도록 돕는 기술입니다. 이를 구축하기 위해서는 크게 세 가지 핵심 요소가 필요합니다. 첫째, 사용자의 질문이나 요청을 처리하고 LLM API를 호출하는 백엔드 API 서버입니다. FastAPI와 Uvicorn을 사용하여 이를 구현할 수 있습니다. 둘째, 검색할 정보를 저장하고 관리하는 데이터베이스입니다. PostgreSQL을 사용하며 SQLAlchemy를 통해 파이썬 코드에서 접근합니다. 셋째, 사용자의 질문과 관련된 정보를 데이터베이스에서 효율적으로 찾아 LLM에 전달하는 검색(Retrieval) 로직입니다. 이 로직은 사용자의 입력과 가장 유사한 문서를 찾는 방식으로 구현될 수 있습니다.

자세한 구축 과정은 원본 글에서 확인하세요.