AI 음성 복제 범죄, 즉 딥보이스 기술은 "여보세요?"와 같은 짧은 음성 샘플만으로도 특정인의 목소리를 완벽하게 흉내 낼 수 있어 심각한 사회 문제로 대두되고 있습니다. 특히 침묵 전화 수법은 음성 샘플 수집 및 표적 번호 확보를 위한 사전 작업일 수 있어 주의가 필요합니다.

AI 음성 복제, 얼마나 쉽길래? (2026년 최신 기술 동향)

과거에는 전문가의 영역으로 여겨졌던 목소리 복제가 이제는 2~5초의 짧은 음성 샘플만으로도 가능해졌습니다. AI 기술의 발전으로 특정인의 말투, 억양, 음색까지 정교하게 모방할 수 있게 되었으며, 이는 SF 영화에서나 보던 기술이 현실화되었음을 보여줍니다. 실제로 전문가들은 기존의 예상보다 훨씬 적은 데이터로도 고품질의 음성 복제가 가능하다고 경고하고 있습니다. 이러한 기술 발전은 코인 투자 초기 경험처럼, 예상치 못한 속도로 우리 삶에 영향을 미치고 있습니다.

'침묵 전화'는 사기꾼의 함정? 음성 수집 과정은?

관련 글

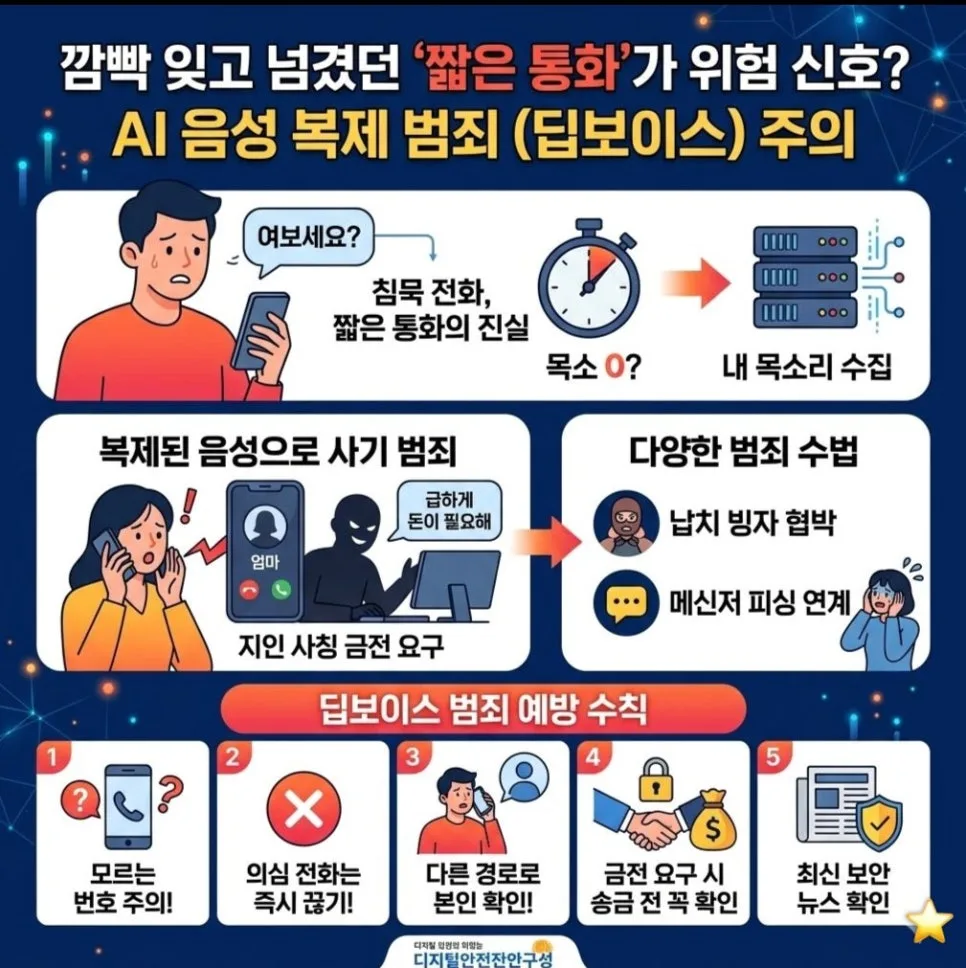

모르는 번호로 걸려온 전화에서 상대방이 아무 말 없이 전화를 끊는 '침묵 전화'는 단순한 오작동이 아닐 수 있습니다. 이는 사기꾼들이 당신의 '여보세요?'라는 음성 샘플을 채취하고, 해당 번호가 실제로 사용 중임을 확인하여 피싱 범죄의 표적으로 삼거나 다크웹에서 거래하기 위한 사전 작업일 가능성이 높습니다. 프랑스 정보통신 전문 매체 GNT의 보도에 따르면, 이러한 수법은 음성 수집, 번호 활성화 확인, 표적 목록 등재 순으로 진행됩니다. 마치 제가 해외 주식 투자 초기, 정보의 중요성을 간과했다가 손해를 본 것처럼, 사소한 음성 정보 하나가 큰 위험을 초래할 수 있습니다. 2024년 상반기 보이스피싱 피해액이 전년 대비 약 50% 증가했다는 점은 이러한 위험이 현실화되고 있음을 보여줍니다.

AI 음성 복제 범죄, 실제 피해 사례는?

AI 음성 복제 기술은 주로 보이스피싱 범죄에 악용됩니다. 복제된 목소리로 가족이나 지인을 사칭하여 긴급 상황을 꾸며내거나 금전적 지원을 요구하는 방식입니다. 예를 들어, 해외에서 친구를 사칭하며 수천만 원을 빌려달라는 메시지를 받는 경우, 만약 이것이 AI로 복제된 목소리였다면 속기 쉬웠을 것입니다. 이러한 범죄는 피해자의 심리적 취약점을 파고들어 순식간에 금전적 피해를 입히며, 심각한 경우 개인의 신뢰도까지 위협할 수 있습니다. 드론 운용 시에도 기술 발전의 양면성을 경험했듯, AI 음성 복제 기술 역시 악용될 경우 큰 사회적 혼란을 야기할 수 있습니다.

내 목소리를 지키는 현실적인 대처 방법은?

AI 음성 복제 범죄로부터 자신을 보호하기 위한 몇 가지 현실적인 방법들이 있습니다. 첫째, 모르는 번호로 걸려온 전화에서 상대방이 침묵하면 즉시 전화를 끊는 것이 좋습니다. 둘째, 상대방이 누구인지, 왜 전화했는지 먼저 묻거나 자신의 이름을 먼저 대면서 불필요하게 목소리를 노출하지 않도록 주의해야 합니다. 이는 마치 주식 투자 시 충분한 정보 없이 섣불리 투자하지 않는 것과 같은 맥락입니다. 특히 가족이나 지인을 사칭하며 금전을 요구하는 전화라면 더욱 신중하게 대처해야 합니다. 이러한 기본적인 수칙을 지키는 것만으로도 AI 음성 복제 범죄의 위험에서 상당 부분 안전해질 수 있습니다. 개인의 상황에 따라 대처 방식이 달라질 수 있으므로, 의심스러운 상황에서는 관련 기관에 문의하는 것이 좋습니다.

AI 음성 복제 범죄 예방을 위한 자세한 정보는 원본 글에서 확인하세요.