신경망이 예측 오차를 줄이기 위해 사용하는 핵심 학습 원리는 역전파(Backpropagation)입니다. 이는 출력층에서 발생한 오차를 입력층 방향으로 거꾸로 전달하며 각 층의 가중치를 조정하는 과정입니다.

신경망 학습의 핵심, 역전파란 무엇인가요?

신경망은 처음에는 무작위 가중치로 시작하여 예측을 수행합니다. 이 예측값과 실제 정답 간의 차이를 '오차'라고 하며, 이 오차를 최소화하는 것이 신경망 학습의 목표입니다. 역전파는 바로 이 오차 정보를 출력층에서부터 입력층 방향으로 거꾸로 전달하면서, 각 연결 가중치가 오차에 얼마나 기여했는지를 계산하는 알고리즘입니다. 마치 시험에서 틀린 문제를 복습하며 어느 부분에서 실수가 있었는지 거슬러 올라가 원인을 파악하는 것과 같습니다. 이 과정을 통해 신경망은 점진적으로 더 정확한 예측을 할 수 있게 됩니다. 경험상, 이 역전파 과정이 신경망의 성능을 좌우하는 가장 중요한 요소입니다.

순전파와 역전파, 어떻게 함께 작동하나요?

관련 글

신경망 학습은 순전파(Forward Propagation)와 역전파(Backpropagation)의 반복으로 이루어집니다. 먼저 순전파 단계에서는 입력 데이터가 신경망의 각 층을 순서대로 통과하며 최종 예측값을 생성합니다. 이 예측값은 실제 정답과 비교되어 오차를 계산하는 데 사용됩니다. 이후 역전파 단계에서는 이 계산된 오차를 출력층에서부터 입력층 방향으로 거꾸로 전달하며, 각 층의 가중치와 편향을 업데이트합니다. 이 업데이트는 오차를 줄이는 방향으로 이루어지며, 이 과정을 수없이 반복함으로써 신경망은 점차 성능을 향상시킵니다. 마치 물이 파이프를 따라 흐르듯, 순전파는 정보의 흐름을, 역전파는 학습을 위한 수정 신호의 흐름을 나타냅니다.

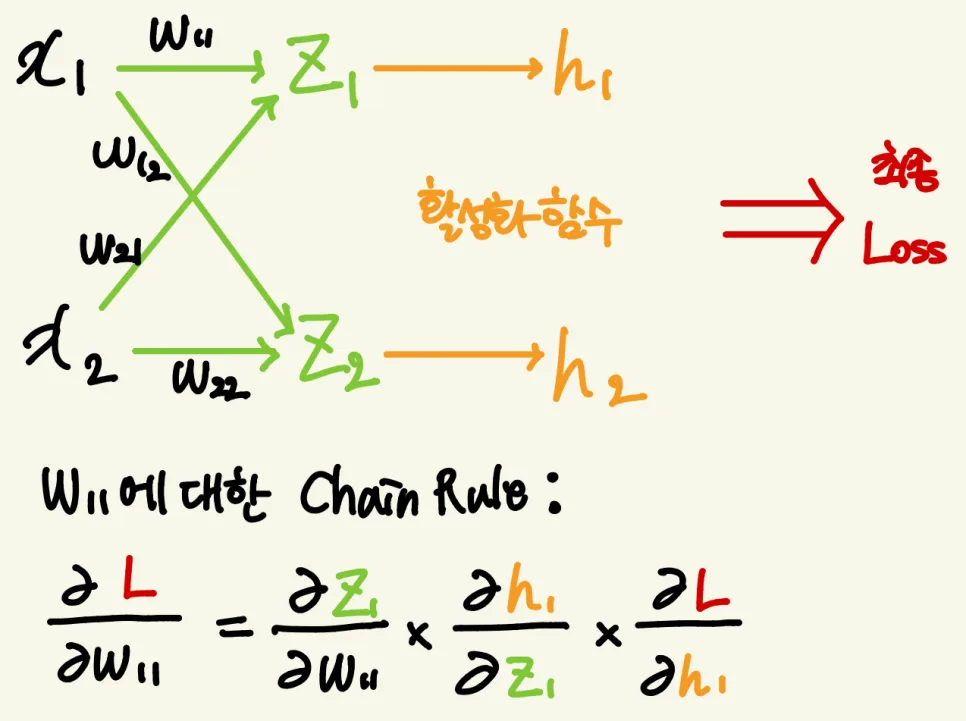

역전파 계산 시 체인룰(Chain Rule)은 왜 중요한가요?

신경망은 여러 개의 작은 함수(가중합 연산과 활성화 함수)가 연속적으로 연결된 거대한 합성 함수로 볼 수 있습니다. 이러한 합성 함수의 미분을 계산할 때 수학적으로 '체인룰'이라는 규칙이 사용됩니다. 역전파 과정에서는 각 층의 가중치가 최종 오차에 미치는 영향을 계산해야 하는데, 이는 합성 함수의 미분을 구하는 것과 같습니다. 따라서 체인룰은 역전파 알고리즘의 핵심적인 수학적 도구로 활용됩니다. 체인룰을 통해 각 층의 가중치에 대한 손실 함수의 그래디언트(기울기)를 효율적으로 계산할 수 있으며, 이를 바탕으로 가중치를 업데이트하여 오차를 줄여나갑니다. 금융 분야의 복잡한 파생 상품 가격 결정 모델에서도 유사한 미분 및 최적화 기법이 활용되는 것처럼, AI 학습에서도 체인룰은 필수적입니다.

역전파 학습 시 주의할 점은 무엇인가요?

역전파는 강력한 학습 방법이지만, 몇 가지 주의할 점이 있습니다. 첫째, '기울기 소실(Vanishing Gradient)' 문제입니다. 층이 매우 깊은 신경망에서는 역전파 과정에서 그래디언트가 점점 작아져 초기 층의 가중치가 거의 업데이트되지 않는 현상이 발생할 수 있습니다. 반대로 '기울기 폭주(Exploding Gradient)' 현상으로 그래디언트가 너무 커져 학습이 불안정해질 수도 있습니다. 이를 해결하기 위해 활성화 함수로 ReLU를 사용하거나, 가중치 초기화 기법, 배치 정규화(Batch Normalization) 등을 적용합니다. 둘째, 과적합(Overfitting) 문제입니다. 신경망이 학습 데이터에만 너무 최적화되어 새로운 데이터에 대한 예측 성능이 떨어지는 현상입니다. 이를 방지하기 위해 드롭아웃(Dropout)이나 조기 종료(Early Stopping)와 같은 규제 기법을 사용합니다.

공유하기

💬자주 묻는 질문

신경망의 역전파는 정확히 무엇인가요?

순전파와 역전파는 어떻게 다른가요?

역전파 시 기울기 소실 문제는 어떻게 해결하나요?

원문 작성자