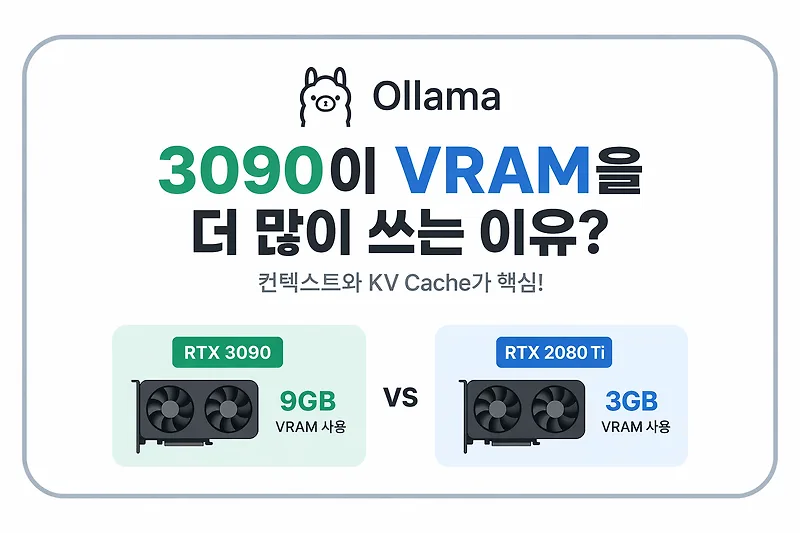

Ollama에서 그래픽 카드별 VRAM 사용량이 다른 이유는 GPU VRAM 크기에 따라 기본 컨텍스트(Context) 길이가 다르게 설정되기 때문입니다. 실제 경험에 따르면, 3090(24GB)은 약 9GB를 사용하는 반면 2080Ti(11GB)는 약 3GB를 사용했습니다.

Ollama GPU VRAM 사용량, 왜 다를까요?

Ollama에서 동일한 AI 모델을 사용하더라도 그래픽 카드별 VRAM 사용량이 크게 차이 나는 현상은 흔히 발생합니다. 직접 테스트한 결과, 3090(24GB) 모델에서는 약 9GB의 VRAM이 사용된 반면, 2080Ti(11GB) 모델에서는 약 3GB의 VRAM이 사용되었습니다. 두 GPU 모두 100% 사용률을 기록하고 있었음에도 불구하고 이러한 차이가 발생하는 원인을 파악하는 것이 중요합니다. 이는 단순히 GPU 성능 차이 때문만이 아니라, Ollama의 내부 작동 방식과 관련이 깊습니다.

이러한 VRAM 사용량의 차이는 주로 AI 모델이 처리하는 '컨텍스트 길이(Context Length)' 설정에서 비롯됩니다. 컨텍스트 길이가 길어질수록 AI는 더 많은 이전 정보를 기억하고 활용할 수 있게 되는데, 이는 내부적으로 'KV 캐시(Key-Value Cache)'라는 메모리 영역의 크기를 증가시킵니다. KV 캐시는 AI가 이전 토큰(단어 또는 문자의 단위)을 빠르게 참조하여 응답의 일관성과 정확성을 높이는 데 필수적인 역할을 합니다. 따라서 컨텍스트 길이가 길어지면 KV 캐시 메모리 또한 비례하여 증가하게 됩니다.

GPU VRAM 크기에 따른 Ollama 기본 컨텍스트 길이 설정은?

관련 글

Ollama는 사용자의 GPU VRAM 용량을 고려하여 AI 모델의 기본 컨텍스트 길이를 자동으로 조절합니다. 예를 들어, 2080Ti(11GB) 모델의 경우 일반적으로 4K(4096 토큰)의 컨텍스트 길이가 기본값으로 설정되는 반면, 3090(24GB)과 같이 VRAM이 더 큰 그래픽 카드는 32K(32768 토큰)와 같이 훨씬 긴 컨텍스트 길이를 기본값으로 설정합니다. 이러한 자동 설정은 사용자가 직접 컨텍스트 길이를 조정하는 번거로움을 줄여주지만, VRAM 사용량의 차이를 유발하는 주요 원인이 됩니다. 컨텍스트 길이가 길수록 더 많은 VRAM을 필요로 하므로, VRAM이 큰 GPU에서 더 많은 메모리가 사용되는 것은 자연스러운 현상입니다.

동일 모델, 다른 VRAM 사용량의 핵심 원인은?

결론적으로, 동일한 AI 모델을 사용하더라도 Ollama에서 그래픽 카드별 VRAM 사용량이 달라지는 핵심 이유는 GPU의 VRAM 크기에 따라 Ollama가 자동으로 설정하는 기본 컨텍스트 길이가 다르기 때문입니다. 컨텍스트 길이가 길어지면 AI가 이전 정보를 참조하기 위한 KV 캐시 메모리 또한 커지게 되고, 이는 곧 더 많은 VRAM을 소모하게 되는 결과를 가져옵니다. 따라서 3090(24GB)이 2080Ti(11GB)보다 약 3배의 VRAM을 사용하는 것은 이러한 컨텍스트 길이 및 KV 캐시 크기 차이에서 기인한다고 볼 수 있습니다.

더 자세한 내용은 원본 글에서 확인하세요.