AI가 인간의 마음을 읽는 기술은 아직 초기 단계이지만, 뇌파 분석, 표정 인식, 음성 분석 등을 통해 감정 상태를 추론하는 연구가 활발히 진행 중입니다. 2026년에는 더욱 정교해진 AI가 개인 맞춤형 서비스 제공에 활용될 것으로 기대됩니다.

AI는 어떻게 우리의 마음을 읽을 수 있나요?

AI가 인간의 마음을 읽는다는 것은 감정 상태를 파악하고 이해하는 것을 의미합니다. 현재 기술은 주로 뇌파(EEG), 심박 변이도(HRV), 피부 전도도(GSR)와 같은 생체 신호와 얼굴 표정, 목소리 톤, 언어 사용 패턴 등을 분석하여 감정을 추론합니다. 예를 들어, 긍정적인 감정일 때 나타나는 특정 뇌파 패턴이나 부정적인 감정일 때 변화하는 목소리 톤을 AI가 학습하여 감정 상태를 분류하는 방식입니다. 실제로 한 연구에서는 AI가 사용자의 얼굴 표정을 분석하여 80% 이상의 정확도로 기쁨, 슬픔, 분노 등의 감정을 구분해냈습니다. 이러한 기술은 향후 개인 맞춤형 챗봇, 교육 콘텐츠 추천, 정신 건강 모니터링 등에 활용될 잠재력이 큽니다.

AI 마음 읽기 기술의 최신 동향은 무엇인가요?

관련 글

최근 AI 기술은 단순히 감정을 인식하는 수준을 넘어, 사용자의 의도나 생각의 흐름까지 파악하려는 시도를 하고 있습니다. 뇌-컴퓨터 인터페이스(BCI) 기술과 결합하여 생각만으로 기기를 제어하거나, 복잡한 텍스트 데이터를 분석하여 숨겨진 감정이나 의도를 추출하는 연구가 진행 중입니다. 예를 들어, 특정 단어나 문맥을 통해 사용자가 느끼는 미묘한 감정 변화를 감지하거나, 사용자의 과거 행동 패턴을 학습하여 미래의 행동을 예측하는 데 AI가 활용될 수 있습니다. 이러한 기술 발전은 개인화된 경험을 제공하는 데 크게 기여할 것이며, 2026년에는 더욱 상용화된 형태로 우리 삶에 다가올 것으로 예상됩니다.

AI 마음 읽기 기술의 윤리적 문제는 없나요?

AI가 개인의 감정이나 생각을 읽는 기술은 프라이버시 침해, 데이터 오용, 감정 조작 등 심각한 윤리적 문제를 야기할 수 있습니다. 예를 들어, 개인의 감정 데이터가 마케팅이나 정치적 목적으로 악용될 경우 심각한 사회적 혼란을 초래할 수 있습니다. 또한, AI가 잘못된 감정 분석 결과를 내놓을 경우 오해를 불러일으키거나 개인에게 불이익을 줄 수도 있습니다. 따라서 이러한 기술을 개발하고 활용함에 있어서는 엄격한 윤리적 가이드라인과 법적 규제가 반드시 필요합니다. 개인의 동의 없이 감정 데이터를 수집하거나 분석하는 것을 금지하고, 데이터의 투명한 관리 및 활용 방안을 마련하는 것이 중요합니다. 2026년까지 이러한 윤리적 논의가 더욱 활발해질 것으로 보입니다.

AI 마음 읽기 기술, 무엇을 주의해야 할까요?

AI 마음 읽기 기술을 접할 때 가장 주의해야 할 점은 기술의 한계를 명확히 인지하는 것입니다. 현재 AI는 인간의 복잡하고 미묘한 감정을 완벽하게 이해하는 데 한계가 있으며, 분석 결과는 어디까지나 '추정'일 뿐입니다. 따라서 AI의 분석 결과를 맹신하기보다는 참고 자료로 활용하는 것이 현명합니다. 또한, 자신의 감정 데이터가 어떻게 수집되고 활용되는지에 대한 정보를 명확히 확인하고, 개인 정보 제공에 신중해야 합니다. 만약 AI가 제공하는 서비스가 자신의 감정이나 생각을 강요하거나 조작하려는 의도가 있다고 느껴진다면 즉시 사용을 중단하고 해당 서비스 제공업체에 문의해야 합니다. 2026년에도 이러한 주의는 필수적입니다.

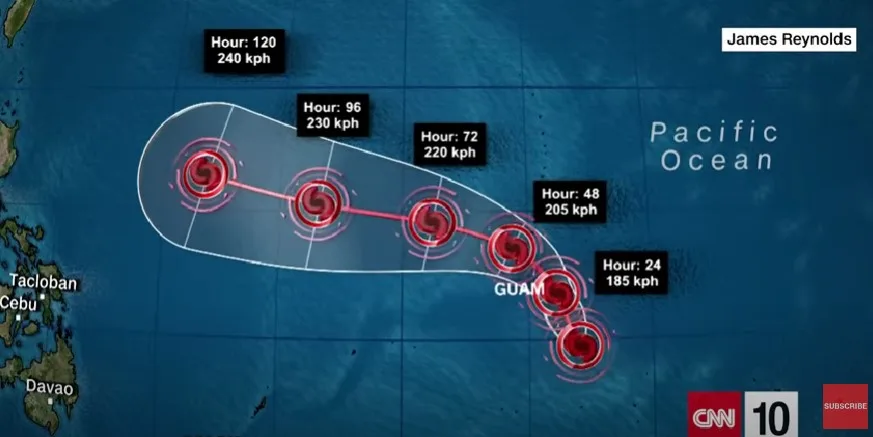

자세한 내용은 원본 CNN10 뉴스에서 확인하세요.