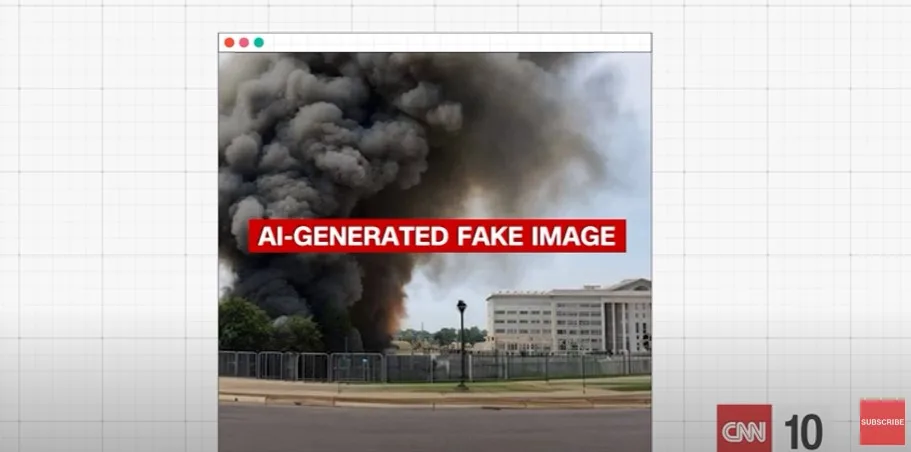

AI가 생성한 가짜 이미지로 펜타곤 폭발 오보 사건이 발생했습니다. 전문가들은 이러한 AI 생성 이미지의 특징을 파악하고, 소셜 미디어에서 정보를 접할 때 비판적으로 검증하는 것이 중요하다고 강조합니다.

AI 이미지로 인한 펜타곤 폭발 오보 사건은 어떻게 발생했나요?

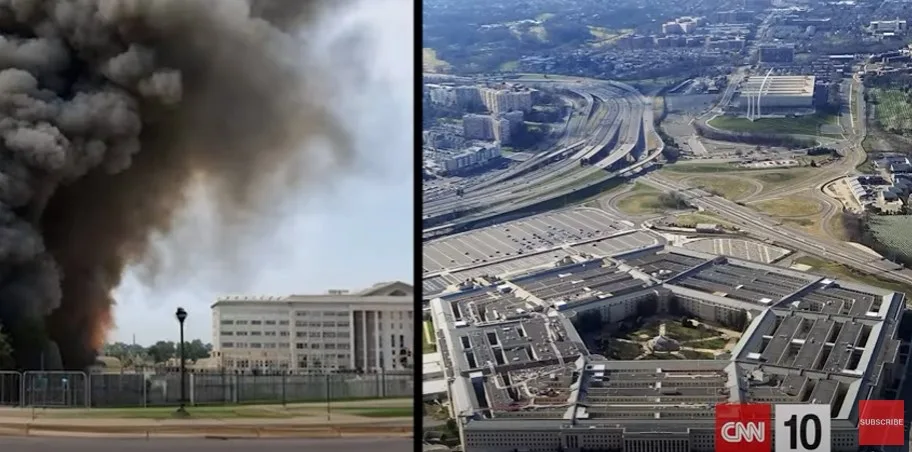

2023년 5월 24일, 워싱턴 D.C. 펜타곤 인근에서 대규모 폭발이 발생했다는 가짜 이미지가 소셜 미디어를 통해 급속도로 확산되었습니다. 이 이미지는 마치 실제 사건처럼 보였지만, 전문가들은 AI(인공지능)에 의해 생성된 가짜 이미지임을 밝혀냈습니다. 놀랍게도 이 가짜 이미지는 블룸버그 통신과 연관된 것처럼 보이는 검증된 트위터 계정을 포함한 여러 계정을 통해 공유되었으며, 이는 AI 생성 콘텐츠의 위험성을 여실히 보여줍니다. 실제 펜타곤 건물과는 전혀 닮지 않은 이미지였음에도 불구하고, 이러한 허위 정보는 빠르게 퍼져나가 혼란을 야기했습니다.

가짜 뉴스는 어떻게 금융 시장에 영향을 미쳤나요?

관련 글

펜타곤 폭발 관련 가짜 뉴스는 단순한 정보 혼란을 넘어 실제 금융 시장에까지 영향을 미쳤습니다. 허위 보도가 확산되면서 주식 시장은 잠시 동안 하락세를 보였으며, 이는 AI 생성 가짜 뉴스가 경제에 미칠 수 있는 파급력을 보여주는 사례입니다. 심지어 일부 국제 언론 매체까지 이 가짜 이미지에 속아 보도하는 상황이 발생했습니다. 러시아의 뉴스 매체 RT는 이 사건을 인용하여 보도했으나, 사건이 실제로 일어나지 않았음이 명확해지자 해당 보도를 철회했습니다. 이처럼 AI 기술의 발전은 정보의 신뢰성을 검증하는 데 더욱 신중해야 함을 시사합니다.

AI 생성 이미지의 특징과 판별 방법은 무엇인가요?

AI가 생성한 이미지는 종종 미묘하지만 결정적인 오류를 포함하고 있습니다. 예를 들어, 사람의 손가락이 비정상적으로 많거나 적게 묘사되거나, 사물의 형태가 왜곡되는 경우가 있습니다. 또한, 이미지의 전체적인 질감이나 조명이 부자연스러울 수 있습니다. 펜타곤 폭발 이미지의 경우, 건물 형태가 실제 펜타곤과 유사하지 않았다는 점이 전문가들에 의해 지적되었습니다. 이러한 가짜 이미지를 판별하기 위해서는 이미지의 출처를 확인하고, 여러 신뢰할 수 있는 언론 매체의 보도를 교차 검증하는 습관이 중요합니다. 또한, 이미지의 세부적인 부분을 주의 깊게 살펴보는 것도 AI 생성 이미지인지 아닌지를 판단하는 데 도움이 됩니다.

AI 가짜 뉴스로부터 자신을 보호하기 위한 주의사항은 무엇인가요?

AI 기술의 발달로 인해 가짜 뉴스, 특히 AI가 생성한 이미지나 텍스트를 식별하는 것이 더욱 어려워지고 있습니다. 따라서 정보를 접할 때 항상 비판적인 시각을 유지하는 것이 중요합니다. 소셜 미디어에서 접하는 충격적인 이미지나 뉴스는 즉시 믿기보다는, 해당 정보의 출처를 확인하고 여러 신뢰할 수 있는 매체를 통해 교차 검증하는 과정을 거쳐야 합니다. 특히, 출처가 불분명하거나 과도하게 자극적인 내용은 더욱 주의 깊게 살펴볼 필요가 있습니다. 이러한 습관을 통해 우리는 AI 가짜 뉴스의 확산을 막고 정확한 정보를 얻는 데 기여할 수 있습니다.

공유하기

💬자주 묻는 질문

AI가 생성한 가짜 이미지를 어떻게 구별할 수 있나요?

AI 가짜 뉴스가 금융 시장에 미치는 영향은 무엇인가요?

AI 가짜 뉴스 시대에 정보를 어떻게 신뢰할 수 있나요?

원문 작성자