2026년 기준, ChatGPT 3.5 등장 이후 AI 윤리와 안보에 대한 인식은 더욱 구체적이고 현실적인 정책 의제로 변화했습니다. 특히 투자자 관점에서 잠재적 리스크를 파악하는 것이 중요해졌습니다.

AI 윤리, 원칙에서 규범으로 어떻게 변화했나요?

ChatGPT 3.5 출시 이전 AI 윤리는 인권, 존엄성, 공정성 등 추상적인 원칙 중심이었습니다. 하지만 2022년 11월 이후, AI 윤리는 실제 서비스, 선거, 저작권, 개인정보, 군사 전략 등 사회 전반에 영향을 미치는 정책 문제로 발전했습니다. 초기에는 편향, 유해 답변, 허위 정보가 주요 이슈였으나, 현재는 모델의 학습 데이터 출처, 결과물 표시 방식, 음성 및 영상 복제 범위, 사고 발생 시 책임 소재 등 더욱 복잡하고 구체적인 문제로 논의가 확장되었습니다. 이는 개인정보 분쟁, 음성 복제 논란, 저작권 소송, 딥페이크 규제 등 실제 사례에서 명확히 드러나고 있습니다. 예를 들어, 이탈리아의 ChatGPT 일시 중단 및 벌금 부과 사건은 AI 윤리가 단순한 '불편한 답변'을 넘어 개인정보 처리의 법적 근거, 아동 보호 장치 유무 등 법규 준수 여부를 따지는 문제로 심화되었음을 보여줍니다.

AI 안보 인식은 어떻게 진화하고 있나요?

AI 안보에 대한 인식 변화는 인간의 정체성 및 민주주의 수호와도 밀접하게 연결되어 있습니다. 2024년 배우 스칼릿 조핸슨의 목소리와 유사한 AI 음성 기능 'Sky' 사용 중단 사례는 AI 기술이 개인의 초상권 및 퍼블리시티권을 침해할 수 있음을 보여주었습니다. 또한, 미국에서 발생한 AI 로보콜을 이용한 정치적 허위 정보 유포 사건은 AI가 선거의 신뢰성을 위협하고 사기 행위에 악용될 수 있다는 우려를 증폭시켰습니다. 이에 따라 FCC는 AI 음성 복제 로보콜을 불법으로 규정하고 관련자에게 벌금을 부과하는 등 제도적 대응에 나섰습니다. 이는 AI 안보가 단순한 기술적 문제를 넘어, 민주주의 시스템의 근간을 흔들 수 있는 사회적, 제도적 문제로 인식되고 있음을 시사합니다. 투자자들은 이러한 AI 안보 관련 규제 강화 추세를 면밀히 주시해야 합니다.

AI 학습 데이터와 저작권 문제는 어떻게 해결되고 있나요?

AI 윤리의 핵심 쟁점 중 하나는 학습 데이터의 저작권 문제입니다. 뉴욕타임스와 작가들이 제기한 OpenAI 저작권 소송, 그리고 Anthropic 사건은 AI 모델이 대규모 데이터를 학습하는 과정에서 발생하는 저작권 침해 문제를 수면 위로 끌어올렸습니다. 미국 법원은 AI 학습 자체는 공정 이용으로 볼 여지를 인정하면서도, 불법 복제된 저작물을 대규모로 보관하는 행위는 정당화될 수 없다고 선을 그었습니다. 이에 따라 Anthropic은 작가 집단 소송에서 합의하고 다운로드한 책 파일을 폐기하는 조치를 취했습니다. 이는 AI 윤리가 '모델이 무엇을 말하는가' 뿐만 아니라 '모델이 무엇으로 학습되었는가'에 대한 문제로까지 확장되었음을 의미합니다. 2025년 이후에는 AI 생성 콘텐츠의 출처 표기 및 저작권 보호에 대한 더욱 엄격한 기준이 적용될 것으로 예상됩니다.

EU AI Act 발효, AI 규제는 어떻게 진행되나요?

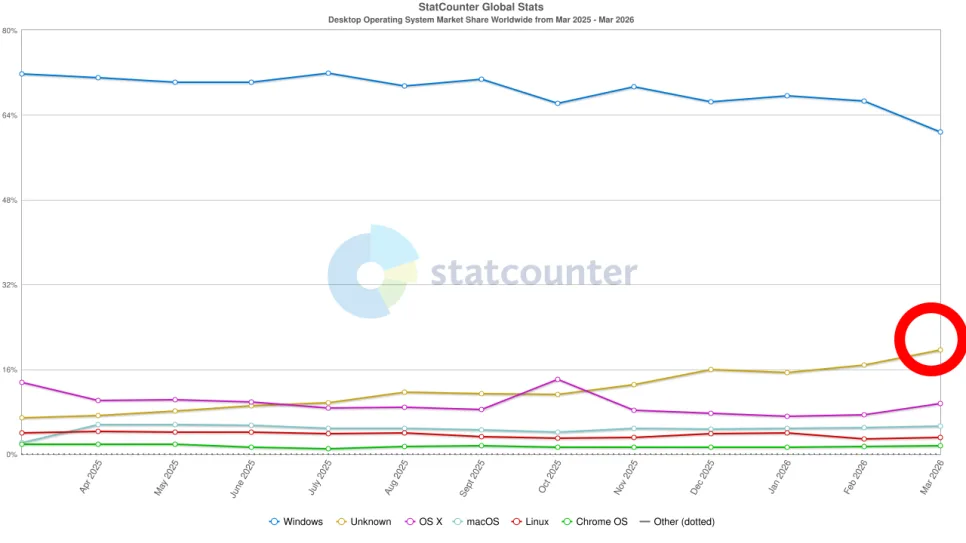

유럽연합(EU)의 AI Act는 AI 규제에 대한 가장 명확한 로드맵을 제시합니다. 2024년 8월 발효된 이 법은 2025년 2월부터 AI 리터러시 의무 및 금지된 AI 관행에 대한 규제를 시작했으며, 2025년 8월부터는 범용 AI 모델에 대한 의무가 적용됩니다. 최종적으로 2026년 8월 2일 법 전체가 전면 적용될 예정입니다. 특히 EU AI Act는 AI 시스템의 투명성을 강화하여, 사람과 상호작용하는 AI임을 명확히 알리도록 하고 AI 생성 콘텐츠 및 딥페이크에는 반드시 표시를 요구합니다. 또한, 공익 관련 텍스트에도 인공적 기원임을 고지하도록 하여 사용자의 알 권리를 보장합니다. 이러한 EU의 선제적인 규제 움직임은 전 세계 AI 규제 논의에 큰 영향을 미칠 것으로 보이며, 투자자들은 각국의 AI 규제 동향을 면밀히 파악하고 잠재적 리스크에 대비해야 합니다.

AI 윤리와 안보 관련 최신 동향을 더 자세히 알아보세요.