SK네트웍스 Family AI 캠프 2주차에는 파이썬에 이어 데이터베이스 개념과 MySQL 활용법, 그리고 웹 크롤링의 기초까지 다루며 방대한 학습량을 소화했습니다. 비전공자도 빠르게 웹 UI를 구현하는 Streamlit 활용법과 데이터 추출 및 시각화를 위한 SQL 쿼리 작성법을 익혔습니다.

비전공자를 위한 AI 캠프 2주차: Streamlit으로 웹 UI 빠르게 구현하기

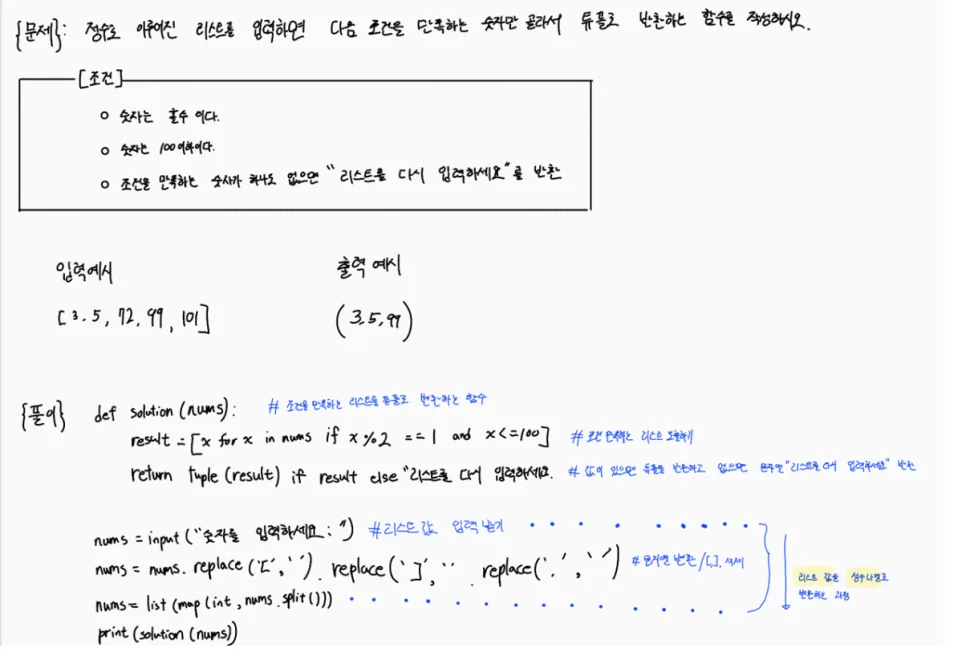

SK네트웍스 Family AI 캠프 30기 2주차는 파이썬 기초를 마친 비전공자들에게 '가속도'와 같은 시간이었습니다. 4월 6일부터 10일까지 Streamlit, 데이터베이스, SQL, 웹 크롤링이라는 방대한 커리큘럼이 쏟아졌죠. 일주일 만에 모든 내용을 완벽히 소화하기는 어려웠지만, 중요한 것은 진도에 매몰되지 않고 현재 눈앞의 코드 한 줄에 집중하는 학습 철학입니다. 실제로 Streamlit의 st.metric 함수를 활용하면 '어제 대비 혼잡도 45% (▼ 5%)'와 같은 직관적인 지표를 프론트엔드 지식 없이도 단 한 줄의 코드로 전문적인 대시보드 형태로 만들 수 있습니다. 이는 단순 텍스트 출력인 st.write와 달리 데이터의 가치를 시각적으로 극대화하며, 코딩이 이렇게 빠르게 결과물을 만들 수 있는 도구임을 실감하게 합니다. 이러한 기술적 편의성은 학습 방식을 암기에서 공식 문서를 찾아 필요한 기능을 즉시 구현하는 '적용하는 공부'로 전환하게 돕습니다.

데이터베이스와 MySQL: 휘발성 데이터를 체계적으로 관리하는 방법

관련 글

파이썬 실습 이후에는 휘발성 데이터를 체계적으로 관리하기 위한 저장소로서 데이터베이스(DB)의 개념을 확립하고, 오픈소스인 MySQL을 활용해 환경을 구축했습니다. 비전공자로서 쿼리문 작성보다 VS Code 연동이나 설치 등 초기 환경 설정에서 큰 난관을 겪었으나, AI 챗봇을 활용해 이를 자가 해결하며 현대적인 학습 방식을 실천했습니다. 데이터 구축 프로세스는 현실 데이터를 추상화하는 개념적 모델링(ERD), 테이블 분리와 정규화를 진행하는 논리적 모델링, 실제 시스템에 구현하는 물리적 모델링의 3단계를 거칩니다. 흩어진 정보를 관계(Relation)로 묶어 관리하는 과정을 '복잡한 퍼즐 맞추기'에 비유하며 데이터 구조화의 본질을 파악했습니다. 단순히 데이터를 쌓는 것을 넘어 구조적 설계를 통해 무결성과 효율성을 확보하는 원리를 체계화하며 데이터 엔지니어링의 기초를 견고히 다졌습니다.

SQL 쿼리 기초: DBeaver와 Pandas를 활용한 데이터 추출 및 시각화

데이터베이스에서 가치 있는 통찰을 도출하기 위해서는 원시 데이터를 필터링하고 집계하는 SQL 쿼리 능력이 필수적입니다. 이번 과정에서는 DBeaver와 파이썬 라이브러리(Pandas, Matplotlib)를 연동하여 데이터 추출부터 시각화까지의 전체 파이프라인을 경험했습니다. 특히 지하철 데이터를 활용한 실습에서 가장 큰 기술적 고비는 'JOIN' 개념이었으나, 이는 데이터 분석의 핵심이기에 각 조인의 종류를 집합 논리에 따라 체계적으로 정리했습니다. INNER JOIN부터 CROSS JOIN까지 서로 다른 테이블이 결합되는 원리를 파악하며, 단순히 코드를 받아쓰는 수준을 넘어 새로운 관점의 데이터를 생성하는 논리적 핸들링 능력을 키워나갔습니다. 이러한 학습 과정은